Verloren verlangen, moderne romantische representaties van landschap in de schilderkunst en foto

Een toepassing van D-PACd-pac.be › wp-content › uploads › 2017 › 11 ›...

Transcript of Een toepassing van D-PACd-pac.be › wp-content › uploads › 2017 › 11 ›...

Comparatief beoordelen binnen onderzoek en onderwijs

Een toepassing van D-PAC

Sven De Maeyer Marije LesterhuisRenske Bouwer Maarten GoossensTine van Daal Roos Van GasseSan Verhavert

16-11-2017

1

Wat zijn jouw verwachtingen?

2

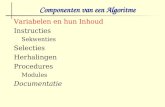

Overzicht

• Waarom comparatief beoordelen? Theoretische achtergrond

• Comparatief beoordelen in de praktijk• Voorwaarden om een comparatief assessment op te

zetten• Hands-on: D-PAC try-out

LUNCH

• Hands-on: resultaten en analyses

3

Waarom comparatief beoordelen? Theoretische achtergrond

4

So you think you can judge?!

-> Criteria? Beoordelingsschaal?-> Moeilijkheden? Problemen?

Danser 1 Danser 2

Danser 3 Danser 4

5

Comparatief beoordelen... Wie is de beste danser?

?

?

?

6

Waarom comparatief beoordelen?

• Holistisch and relatief (Pollitt, 2012)• Gedeelde consensus ~ groep van beoordelaars (van Daal

et al., 2016)• Gebruik van expertise (Pollitt, 2012; Jones et al., 2015)

=> Verhoogt validiteit! (Jones & Inglis, 2015; Pollitt & Crisp, 2004; Pollitt, 2012)

• Breed toepasbaar (e.g., Heldsinger & Humphry, 2010; Jones & Alcock, 2014; Pollitt, 2012):– Competenties die moeilijk te vervatten zijn in criteria– Verwachte verschillen in antwoorden– Performances

7

Informatie uit comparatief beoordelen

● Bradley-Terry-Luce model:○ Kwaliteitsscores (in logits) met betrouwbaarheidsinterval○ Rangorde

● Scale Separation ReliabilityGeeft schatting van interbeoordelaars betrouwbaarheid (Verhavert, 2017)

● Misfit data voor beoordelaars Welke beoordelaars hebben een ‘andere’ kijk (in vergelijking met de gedeelde

consensus van beoordelaars?)

● Misfit data voor representatiesWelke representatie(s) zijn moeilijk te beoordelen?

8

Rangorde met kwaliteitsscores9

Misfit van beoordelaars

10

Geschiedenis van comparatief beoordelen

1927 2004

Thurstone

2007

2009

2014 - 2017

Pollitt

Bramley

Kimbell

11

Comparatief beoordelen in de praktijk ...

12

Implementatie in de praktijk

Comparatief beoordelen om complexe groepsbeslissingen te maken, monitoren of verbeteren

Waarom?- Vergelijken is makkelijker en betrouwbaarder dan absoluut

beoordelen (Laming, 2004; Thurstone, 1927)- De rangorde geeft de gedeelde consensus van

beoordelaars weer (van Daal et al., 2017)- Geeft inzicht in de mate waarin beoordelaars of

representaties afwijken van de groepsconsensus

13

Praktijkvoorbeelden van comparatief beoordelen

- Summatieve beoordeling van competenties- Prioriteren van ideeën of agendapunten- Selectie van cv’s, portfolio’s, projectvoorstellen

14

Praktijkvoorbeelden van comparatief beoordelen

Als tool om te leren:- Formatieve beoordeling & peer assessment- Professionalisering van beoordelaars

15

Taak 1: Bedenk een casus

- Hoe zou jij comparatief beoordelen kunnen gebruiken in jouw (onderzoeks)context? Welke doelen & vragen heb je daarbij?

- Waarmee dien je rekening te houden bij de implementatie van comparatief beoordelen in jouw (onderzoeks)context? Denk aan verschillende actoren, doelen, taken, etc.

16

Voorwaarden om een comparatief assessment op te zetten

17

Voorwaarden voor valide & betrouwbare resultaten

Bij gebruik van random paarsgewijze vergelijking:- Aantal vergelijkingen?- Aantal en kenmerken van beoordelaars?

Andere algoritmes voor selectie van paren:- Adaptief algoritme- Plaatsingsalgoritme- Equal views- Triplets

18

Hoeveel vergelijkingen voor betrouwbare resultaten?

Verschillende assessments = andere resultaten

19

Meta-analyse van betrouwbaarheid

49 assessments in D-PAC• gemiddelde betrouwbaarheid = .79 (.49 to .99)• aantal representaties: 84 (6 to 1089)• aantal beoordelaars: 29 (4 to 127)• verschillende representaties en competenties• in verschillende contexten (onderwijs, onderzoek, werkplek)

Verhavert, Bouwer, De Maeyer, & Donche, in prep

20

Resultaten meta-analyse

Effect van kenmerken van assessments op betrouwbaarheid:• Aantal vergelijkingen per representatie• Totaal aantal vergelijkingen• Aantal beoordelaars• Aantal vergelijkingen per beoordelaar• Type representaties (tekst, video, audio, beelden)• Type feedback (geen, comparatief, pros/cons)• Expertise van beoordelaar (experts, novices, peers)

Verhavert, Bouwer, De Maeyer, & Donche, in prep

21

Aantal vergelijkingen

SSR 0.70: 8-12 vergelijkingen per representatieSSR 0.80: 16-20 vergelijkingen per representatie

Verhavert, Bouwer, De Maeyer, & Donche, in prep

22

Aantal vergelijkingen per beoordelaar

Voor een bijkomende toename van 0.01 in SSR: +20 vergelijkingen per beoordelaar

Verhavert, Bouwer, De Maeyer, & Donche, in prep

23

Aantal en kenmerken van beoordelaar

Geen effect van beoordelaar op betrouwbaarheid, maar…

Meer beoordelaars:- Verhogen de generaliseerbaarheid van de resultaten:

groep consensus (Van Daal et al., 2017)

- Verhogen de validiteit van de resultaten: verschillen tussen beoordelaars (Lesterhuis et al., 2017)

24

Focus van beoordelaars

Beoordelaars vergelijken teksten op verschillende, maar relevante aspecten van schrijven

Omdat meerdere beoordelaars de vergelijkingen maken, is de rangorde een weergave van de volledige competentie ‘schrijfvaardigheid’.

25

Van Daal, Lesterhuis, Coertjens, Donche & De Maeyer, 2017

Kenmerken beoordelaars

1. Selectie 2. Training & instructie

26

Selectie beoordelaars: verschillen ze?

Lesterhuis, Bouwer, De Maeyer, & Donche, 2017

Docenten, docenten in opleiding en docentenopleiders:

- Aantal jaren ervaring niet relevant

- Achtergrond niet relevant

27

Selectie beoordelaars: is iedereen geschikt?

ER-schema’s- Studenten .73- Docenten .77

Moodboards- Studenten .81 & .73- Docenten .71

Zelfreflecties- Docenten .77- Nitwits .73

r =.62

r =.65 & r =.63

r =.57

28

Effect van training en instructie

Casus 1: geen instructieTeksten 18 & 27 aangepast met typische NT2 fouten

29

Spruyt, 2017

Effect van training en instructie

Casus 2: Informatieve teksten, niet taalconventies!

30

8 studenten 6 studenten 7 studenten

Instructie Instructie Instructie

Getypte teksten Getypte teksten Handgeschreven + spelfouten

30 minuten training

225 vergelijkingen 225 vergelijking 225 vergelijkingen

SSR=.86 (.80 met 6 studenten)

SSR=.77 SSR=.82

R = .83 R = .78

R = .88Bouwer, Lesterhuis, De Smedt, Van Keer, & De Maeyer, 2017

Effect van training en instructie

Bouwer, Lesterhuis, De Smedt, Van Keer, & De Maeyer, 2017

31

Voorwaarden voor valide & betrouwbare resultaten

Bij gebruik van random paarsgewijze vergelijking:- Aantal vergelijkingen?- Aantal en kenmerken van beoordelaars?

Andere algoritmes voor selectie van paren:- Adaptief algoritme- Plaatsingsalgoritme- Equal views- Triplets

32

Adaptief algoritme

● Adaptieve versus random CB

○ Paren worden samengesteld o.b.v. informatie (Pollitt, 2012)

⇒ Efficiënter

○ MAAR: Betrouwbaarheid is vertekend (zie Bramley, 2015)

33

Plaatsingsalgoritme: het beste van beiden? Een tweetraps aanpak in CB

Fase 1: een betrouwbare schaal met random algoritmeFase 2: nieuwe representaties op de schaal plaatsen met een adaptief algoritme

Onderzoeksvraag:Hoe betrouwbaar moet de referentieschaal zijn en hoeveel vergelijkingen zijn nodig voor een accurate plaatsing van nieuwe representaties?

34

Plaatsingsalgoritme: in de praktijk

• CB sessie in samenwerking met International Baccalaureate• 160 essays, 15 beoordelaars en 28 vergelijkingen per essay (SSR = 0.92)• Vier referentiesets van 140 essays met variërende SSR-waarden: .50, .70, .80 en .92• Terugplaatsen van 20 essays o.b.v. het plaatsingsalgoritme (Maximum Fisher Information met verschillende stopcriteria: betrouwbaarheid van .70, .80, en na 10 vergelijkingen)

35

Furlong, Verhavert, Bouwer, & De Maeyer, 2017

Resultaten van een tweetraps aanpak in CB36

Furlong, Verhavert, Bouwer, & De Maeyer, 2017

Een tweetraps aanpak in CB

Wat kunnen we concluderen o.b.v. deze resultaten?

Fase 1: creëer een referentieset met een minimale betrouwbaarheid van .80

Fase 2: plaats nieuwe representaties adaptief en gebruik een stopcriterium van .80

37

Furlong, Verhavert, Bouwer, & De Maeyer, 2017

Equal views

Zijn er situaties waarin het gewenst (of noodzakelijk) is dat alle beoordelaars alle representaties zien tijdens het vergelijken?

38

Equal views

Oplossing: Equal views algoritme

39

Triplets?

• 3 representaties rangschikken i.p.v. 2 vergelijken• Efficiënter? En wat met de betrouwbaarheid?

40

Triplets?41

Triplets?

• Correlatie van kwaliteitsschattingen

42

Triplets?

• Onderzoeken van ...:

– Hoe implementeer je triplets in een tool?– Hoe ervaren beoordelaars triplets?– Wat als representaties zeer veel informatie bevatten?– ...

43

Taak 2: Pas wat je leerde toe op jouw casus

- Pas wat je leerde toe op de casus die je ontwikkelde in taak 1

- Hoe zou je het CB assessment opzetten voor jouw specifieke cases? Wees zo specifiek mogelijk

44

Hands-on: D-PAC Try-out

45

D-PAC Try-out

- Maak enkele vergelijkingen:

Log in de tool: https://sandbox.d-pac.beGa naar ‘Beoordeel’ > ‘D-PAC Event Posters’

- Bekijk de resultaten:

Ga naar ‘Results’ > ‘D-PAC Event Posters’

46

WELKE LUNCH KIES JE?

?

47

Taak 3: Brainstorm over de analyse

- Welke (onderzoeks)vragen kunnen we onszelf stellen bij de D-PAC try-out?

- Welke (bijkomende) analyses zijn nodig om die vragen te beantwoorden?

48

Hands-on: Jamovi / R analyses

49

Overzicht

- Opzet van de “CJanalyses” module in Jamovi- Importeren van de data- Analyse van de betrouwbaarheid van het CJ assessment- Enkele grafieken- Misfits- Aantal vergelijkingen / beoordelaar- Aantal vergelijkingen / representatie- Aantal beoordelaars / representatie- Tijdsanalyses- Evolutie van de betrouwbaarheid

50

Taak 4: Reflectie

- Kijk terug naar jouw casus in taak 1: welke analyse moet je doen voor het beantwoorden van jouw vragen?

- Kun je nog extra vragen bedenken bij jouw casus? Wat zijn de implicaties hiervan voor het opzetten en uitvoeren van het assessment?

51